Curso de Spark

Aprende con el curso de Spark para empresas hasta 100% Bonificado, a medida para tu organización.

¿Por qué elegir el curso de Spark con Imagina Formación?

Totalmente Práctico y Aplicable

Formación en Spark a Medida para tu empresa

100% Bonificable a través de FUNDAE

Curso TUTORIZADO por Expertos en Spark

Formación estratégica para empresas

FUNDAE

Curso hasta 100% Bonificable a través de FUNDAE

Forma a tu equipo sin coste para tu empresa. Este curso de Spark es hasta 100% bonificable a través de FUNDAE.

- Potencia las competencias clave de tus profesionales.

- Accede a una formación práctica, actualizada y orientada a resultados.

- Prepara a tu equipo para los retos del entorno laboral actual.

- Nos ocupamos de la gestión con FUNDAE si tu empresa lo necesita.

A medida

Formación en Spark a medida

Descubre el mejor curso de Spark para empresas a través de nuestra modalidad Aula Virtual Personalizada:

- Sesiones en vivo a través de videoconferencia.

- Temario totalmente personalizado.

- Fechas y horarios adaptados a tu empresa.

- Acceso a las grabaciones.

- 10 horas de acceso a ejercicios autocorregibles.

- Proyectos diseñados a medida para tu equipo.

Aprende practicando

Totalmente Práctico y Aplicable

Formación diseñada para que apliques cada concepto en situaciones reales de tu trabajo, con un enfoque práctico y útil desde el primer momento.

- Aprendizaje 100% práctico, enfocado en lo que realmente necesitas.

- Casos reales y ejercicios adaptados a tu entorno profesional.

- Aplica cada conocimiento directamente en tus tareas diarias.

- Mejora tu rendimiento y el de tu equipo desde el primer día.

Empresas como Uber, Netflix o Airbnb impulsan sus datos con Apache Spark

Formación en el framework Spark bonificada hasta al 100% por FUNDAE. Curso online tutorizado, flexible y adaptado a las necesidades de tu empresa.

¿Te imaginas tener un Temario 100% Personalizado para tu Empresa?

ME INTERESA

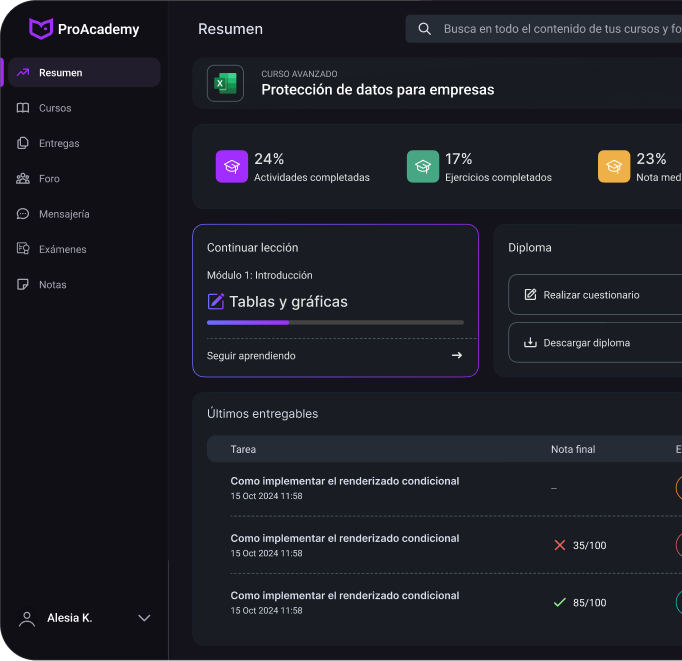

Nueva Plataforma de

E-learning

Contenidos 24/7 actualizados. Aprende a tu ritmo, sin horarios fijos ni fechas de caducidad.

Cumple normativa oficial. Registro automático de conexiones y diplomas válidos para bonificación.

Acceso a todas las grabaciones. Repasa conceptos clave o recupera clases cuando lo necesites.

Retos con validación instantánea. Recibe feedback automático de tu ejercicio y mejora al momento.

Practica y mejora con nuestra plataforma

Una plataforma práctica, con IA integrada y pensada para que mejores desarrollando. Se adapta a tu ritmo, te corrige al instante y te muestra tu progreso real.

Corrección mágica

Feedback inteligente

Aprende de cada acierto y fallo con explicaciones claras

Temario del curso

Encuentra todo el temario del curso aquí.

El problema del Big Data

¿Qué es Spark?

Usos de Spark en el mundo real

Configurando nuestro IDE: IntelliJ IDEA

¿Qué es Hadoop?

HDFS

Principales comandos de HDFS

Introducción a Yarn

Instalación de Hadoop

¿Qué es HBase?

Instalación de Spark local

Arquitectura

Componentes

Ejecutando la consola interactiva de Spark

Ejercicio de iniciación

Recomendaciones

Introducción

El problema del Big Data

¿Qué es Spark?

Usos de Spark en el mundo real

Configurando nuestro IDE: IntelliJ IDEA

¿Qué es Hadoop?

HDFS

Principales comandos de HDFS

Introducción a Yarn

Instalación de Hadoop

¿Qué es HBase?

Instalación de Spark local

Arquitectura

Componentes

Ejecutando la consola interactiva de Spark

Ejercicio de iniciación

Recomendaciones

Aulas Virtuales Personalizadas

¿Te imaginas tener un Temario 100% Personalizado para tu Empresa?

ME INTERESAPensado para quienes deben dominar Spark en su día a día

Desarrolladores de Backend

Quieren dominar el procesamiento de datos masivos con Spark, optimizando el rendimiento en sus aplicaciones empresariales.

Científicos de Datos

Necesitan manejar grandes volúmenes de datos y aplicar modelos de Machine Learning en Spark para obtener insights empresariales.

Ingenieros de Datos

Desean mejorar sus habilidades en la gestión y orquestación de clústeres, aprovechando la potencia de Spark para procesar grandes conjuntos de datos.

Analistas de Datos

Buscan aprender a usar Spark para transformar y analizar movimientos de datos rápidamente, proporcionando valor a través del análisis empresarial.

Administradores de Sistemas

Deben configurar y monitorizar infraestructuras de Spark, garantizando un entorno estable para el procesamiento de grandes volúmenes de datos.

Equipos de Tecnología Empresarial

Requieren formación en Spark para desarrollar aplicaciones escalables y eficientes que impulsen las iniciativas de Big Data de su organización.

Proveedor con 16 años de experiencia en formación empresarial

Sobre

Resolvemos todas tus dudas sobre nuestra formación en Spark

Resolvemos todas tus dudas sobre nuestra formación

Explora las respuestas a las preguntas que guían a nuestra comunidad. Aquí encontrarás claridad sobre cómo funciona todo, desde el acceso hasta los detalles de los cursos. Si buscas respuestas, este es el lugar para comenzar.

¿Cuáles son los beneficios de realizar el curso de Apache Spark?

¿Cuáles son los beneficios de realizar el curso de Apache Spark?

El curso de Apache Spark te capacitará para manejar grandes volúmenes de datos de manera eficiente. Aprenderás a utilizar estructuras de datos distribuidas, ejecutar aplicaciones en clústeres y aplicar técnicas de procesamiento en tiempo real. Esto mejorará tus competencias en el ámbito del análisis de datos y aumentará tus posibilidades de éxito en proyectos de big data dentro de tu empresa.

¿El curso de Apache Spark se puede bonificar a través de FUNDAE?

¿El curso de Apache Spark se puede bonificar a través de FUNDAE?

Sí, el curso de Apache Spark es bonificable a través de FUNDAE. Las empresas pueden beneficiarse de los créditos disponibles para la formación de sus empleados, lo que puede cubrir hasta el 100% del coste del curso. Si gestionamos la bonificación, aplicamos un cargo extra del 10% del valor del curso + IVA, el cual también es bonificable.

¿En qué modalidades se imparte el curso de Apache Spark?

¿En qué modalidades se imparte el curso de Apache Spark?

El curso de Apache Spark se imparte en modalidad de aula virtual personalizada, utilizando Zoom para las videoconferencias. Esta modalidad permite la interacción en tiempo real con el formador y acceso a las grabaciones, facilitando tanto el aprendizaje como la gestión del tiempo.

¿Qué habilidades desarrollaré con el curso de Apache Spark?

¿Qué habilidades desarrollaré con el curso de Apache Spark?

Con el curso de Apache Spark, desarrollarás habilidades para trabajar con datos a gran escala, aplicar transformaciones y acciones en RDDs, DataFrames y DataSets, y ejecutar procesos distribuidos. También ganarás experiencia en el despliegue de aplicaciones y la optimización del rendimiento en clusters.

¿Cómo puedo inscribirme en el curso de Apache Spark?

¿Cómo puedo inscribirme en el curso de Apache Spark?

Puedes inscribirte en el curso de Apache Spark completando el formulario de inscripción disponible en nuestra página web. Es importante proporcionar toda la información requerida para asegurarnos de que tu inscripción se procese de manera adecuada y eficiente.

¿Tienes dudas?Estamos aquí para ayudarte

Para que aprendas a diario con nosotros

Da el salto y aprende con nuestros cursos

Cursos similares al curso de Spark

Spark con Python Avanzado

Aumente su conocimiento en Apache Spark con conceptos avanzados.

Spark con Python

Curso integral de Apache Spark con Python que cubre desde fundamentos de Spark Core hasta SQL, MLlib, Structured Streaming y procesamiento avanzado distribuido con PySpark.

Spark con Scala

Apache Spark es un framework de computación en clúster de código abierto, orientado al procesamiento de datos en tiempo real, que provee de una interfaz para programar clústers con paralelismo de datos implícito y tolerancia a fallos y actualmente es el proyecto de Apache más activo.

Aulas Virtuales Personalizadas

Aulas Virtuales

Personalizadas

¿Quieres formar a un grupo de trabajadores con temario a medida?

¡Esta es tu modalidad!

Aulas Virtuales Personalizadas

Aulas Virtuales

Personalizadas

¿Quieres formar a un grupo de trabajadores con temario a medida?

¡Esta es tu modalidad!

© 2026 Imagina Formación. Todos los derechos reservados